Harness Engineering 2026: Der Bauplan um KI-Agenten

Harness Engineering ist die neue Disziplin, mit der Unternehmen 2026 zuverlässige KI-Agenten bauen. Anthropic, Thoughtworks, HumanLayer und Philipp Schmid zeigen: Der Unterschied entscheidet sich im Rahmenwerk, nicht im Modell.

Harness Engineering beschreibt die bewusste Gestaltung aller Komponenten um ein KI-Modell herum: Werkzeuge, Kontext-Kuration, Feedback-Schleifen und Sub-Agenten. Anthropics eigene Experimente zeigen, dass ein besseres Rahmenwerk die Erfolgsquote bei komplexen Coding-Aufgaben um den Faktor zwei bis drei steigert, ohne das Modell zu wechseln. Auf Terminal Bench 2.0 fällt Claude Opus 4.6 je nach Umgebung von Rang 5 auf Rang 33. Für deutsche Unternehmen bedeutet das: Wer 2026 produktive KI-Agenten einsetzt, muss das Rahmenwerk dokumentieren und messen, nicht nur das Modell auswählen.

Was ist Harness Engineering

Harness Engineering ist die Disziplin, alles rund um ein KI-Modell bewusst zu entwerfen: Werkzeuge, Kontext-Kuration, Feedback-Schleifen, Speicher, Sicherheits-Hooks und Sub-Agenten. Der Begriff hat sich im ersten Quartal 2026 durchgesetzt, nachdem Anthropic und OpenAI ihn in ihre Engineering-Kommunikation aufgenommen haben. Seine Kernthese ist einfach: Die Unterschiede zwischen den Spitzenmodellen auf statischen Benchmarks werden kleiner, die Unterschiede in der Laufzeit-Umgebung werden größer. Wer 2026 produktive Agenten betreiben will, muss beides steuern, nicht nur das Modell.

Philipp Schmid hat am 5. Januar 2026 das Bild durchgesetzt, das seitdem die Diskussion prägt: Das Modell ist die CPU, das Kontextfenster der RAM, der Agent-Harness das Betriebssystem und der eigentliche Agent die Applikation. Wer nur das Modell auswählt, baut einen Computer ohne Betriebssystem. Wer nur das Kontextfenster vergrößert, kauft mehr RAM ohne Kernel. Erst das Zusammenspiel aller Ebenen ergibt ein funktionierendes System.

Cobus Greyling ordnet die Entwicklung in drei Phasen. Erst SDKs und Frameworks, die den Agenten als Code-Gerüst ermöglichten. Dann Context Engineering, das den Inhalt der Kontextfenster kuratierte. Jetzt Harness Engineering, das die komplette Laufzeit-Umgebung abdeckt. Das Framework-Zeitalter endet, weil Modelle heute rund 80 Prozent der früher an Frameworks delegierten Aufgaben selbst erledigen. Die verbleibenden 20 Prozent sind Persistenz, deterministisches Replay, Kostenkontrolle, Beobachtbarkeit und Fehlerbehandlung. Das ist die Heimat des Harness.

Die Bausteine eines Agent-Rahmenwerks

Ein Harness besteht aus wiederkehrenden Bausteinen, die jeweils eine konkrete Aufgabe übernehmen. Birgitta Böckeler von Thoughtworks hat am 2. April 2026 dafür die klarste Taxonomie veröffentlicht. Sie unterscheidet zwischen Guides, die vor einer Aktion eingreifen, und Sensors, die nach einer Aktion Rückmeldung geben. Beide können deterministisch sein, etwa Linter und Typechecks, oder inferenziell, etwa eine semantische Prüfung durch ein weiteres KI-Modell. Die Unterscheidung hilft, Aufwand und Kosten bewusst zu verteilen.

Tool-Orchestrierung

Dateisystem-Zugriff, Shell-Befehle, Websuche und API-Aufrufe über ein definiertes Protokoll wie MCP. Weniger Tools sind oft mehr, weil sie die Auswahl erleichtern.

Kontext-Kuration

Lange Sessions werden in JSON-Fortschrittsdateien oder Git-Historie gespeichert. Neue Sessions lesen diese Dateien und rekonstruieren den Stand in Sekunden.

Genehmigungsmodell

Claude Code arbeitet standardmäßig im Lesemodus. Jeder schreibende Zugriff braucht eine explizite Zustimmung oder eine vorab definierte Regel.

Hooks

Skripte, die vor oder nach einer Aktion laufen. Typischerweise Tests, Linter und Formatter, die Fehler abfangen, bevor sie in den Commit wandern.

Sub-Agenten

Spezialisierte Unter-Agenten mit eigenem Kontextfenster. Sie übernehmen Recherche, Test oder Review und verhindern Context Rot im Hauptagenten.

Sandbox und Snapshots

Jede Änderung ist reversibel, jede Ausführung läuft in einer abgegrenzten Umgebung. Fehler können zurückgesetzt werden, ohne den Produktivstand zu gefährden.

Ein guter Harness muss nicht den menschlichen Beitrag ersetzen, sondern ihn dorthin lenken, wo er am wichtigsten ist.

Birgitta Böckeler, ThoughtworksBöckeler ordnet die Bausteine drei Regelkategorien zu. Der Wartbarkeits-Harness sichert die interne Code-Qualität. Der Architektur-Fitness-Harness überwacht Laufzeitverhalten und nichtfunktionale Anforderungen. Der Verhaltens-Harness prüft die funktionale Korrektheit und ist 2026 am wenigsten ausgereift. Die drei Kategorien lassen sich wie konzentrische Ringe um das Modell herum denken: Je weiter außen, desto näher an der tatsächlichen Anforderung des Nutzers.

Was die Anthropic-Experimente zeigen

Anthropic hat zwischen November 2025 und März 2026 zwei detaillierte Studien veröffentlicht, die Harness-Designs auf komplexe Aufgaben anwenden. Die Ergebnisse sind eindeutig: Mit besserem Rahmenwerk steigt die Erfolgsquote dramatisch, unabhängig vom Modell. Die Studien liefern damit den bisher stärksten Beleg dafür, dass sich das Investment in den Harness lohnt.

Zwei-Agenten-Rahmenwerk

Justin Young beschreibt ein Setup aus Initialisierer und Coder. Der Initialisierer legt Git-Repo, Fortschrittsdatei und eine Feature-Liste mit über 200 Einträgen an. Der Coder arbeitet die Liste inkrementell ab. Jede Session kann den Stand in wenigen Sekunden rekonstruieren.

Drei-Agenten-Rahmenwerk

Prithvi Rajasekaran stellt ein Design aus Planner, Generator und Evaluator vor. Der Planner erweitert kurze Prompts zu detaillierten Produkt-Specs. Der Generator implementiert inkrementell. Der Evaluator testet mit Playwright und bewertet gegen Sprint-Verträge.

Harness Engineering Definition

Birgitta Böckeler veröffentlicht die bislang präziseste Taxonomie mit Guides und Sensors. Der Martin Fowler Blog macht den Begriff für die breite Engineering-Community anschlussfähig.

Die konkreten Zahlen machen den Effekt greifbar. Ein Retro-Game-Maker kam im Solo-Betrieb nach 20 Minuten und 9 US-Dollar zu keinem spielbaren Ergebnis. Mit vollem Rahmenwerk entstand nach sechs Stunden und rund 200 US-Dollar eine funktionsfähige App mit KI-Features. Der volle Harness ist 20-mal so teuer, liefert aber ein Ergebnis, das im Solo-Betrieb gar nicht existiert. Ähnlich beim DAW Builder: drei Stunden fünfzig Minuten mit Opus 4.6 und einer Kostenstelle von rund 125 US-Dollar für eine funktionierende Musikproduktions-App.

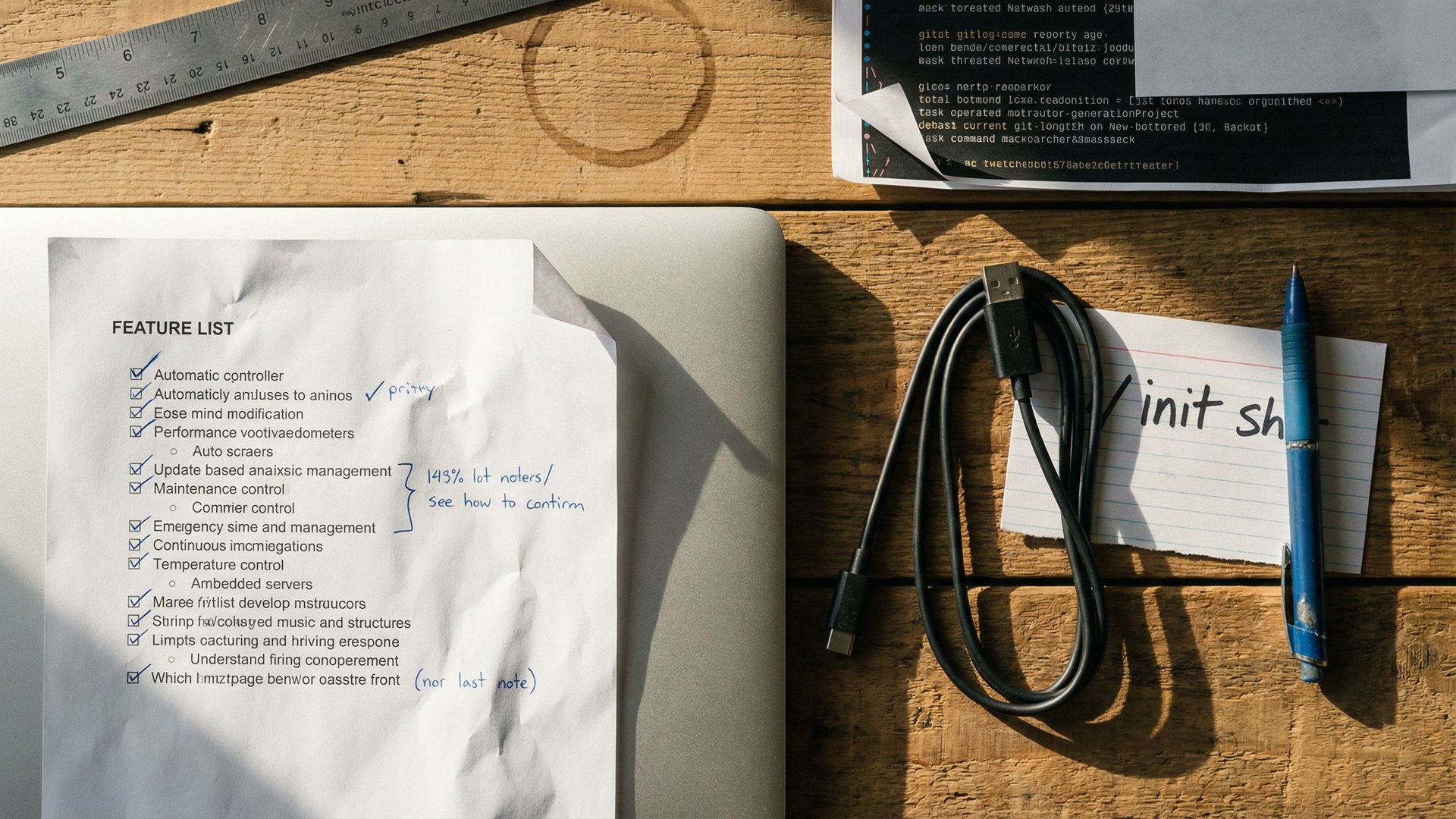

Der technische Kern der Designs ist eine Feature-Liste als JSON-Datei mit mehr als 200 granularen Einträgen, anfangs alle als failing markiert. Dazu kommen eine init.sh für die Umgebung und eine claude-progress.txt für den Fortschritt. Der Agent arbeitet die Liste Stück für Stück ab, testet mit Playwright oder einem Browser-MCP und committet nach jedem erfolgreichen Feature. Das zentrale Problem, das damit gelöst wird, ist die Kontext-Anxiety: Modelle wickeln Arbeit vorzeitig ab, wenn sie sich dem Token-Limit nähern. Kontext-Resets und klare Fortschrittsmarker sind die Antwort darauf.

Mit vollem Harness werden Projekte möglich, die im Solo-Betrieb nicht funktionieren. Die Kosten pro Lauf steigen um den Faktor 20, die Erfolgsquote von null auf funktionsfähig. Das ist kein lineares Investment, sondern eine binäre Entscheidung über die Machbarkeit.

Kritische Studien und der Weg zum Overfitting

Die neue Disziplin ist nicht über jeden Zweifel erhaben. Drei unabhängige Messungen zeigen, dass automatisch erzeugte Rahmenwerke teuer werden können und dass Modelle an spezifische Umgebungen gebunden sind. HumanLayer hat die wichtigsten Befunde am 12. März 2026 zusammengefasst und in eine Warnung verpackt: Harness Engineering darf kein Selbstzweck werden.

ETH Zürich: Automatisch erzeugte Agent-Files

Die Forschung zeigt, dass LLM-generierte Agenten-Konfigurationsdateien die Performance verschlechtern und mehr als 20 Prozent zusätzliche Kosten verursachen. Handgeschriebene Dateien bringen im Schnitt nur rund vier Prozent Verbesserung. Die Lehre: Weniger und manuell ist meist besser als viel und automatisch.

Chroma Research: Context Rot

Je länger das Kontextfenster, desto stärker sinkt die Antwortqualität. Der Effekt ist besonders ausgeprägt, wenn Frage und Kontext semantisch weit auseinander liegen. Mehr Kontext ist nicht gleich besserer Kontext.

Die aussagekräftigste Einzelzahl liefert Terminal Bench 2.0. Claude Opus 4.6 landet in der Standard-Umgebung von Claude Code auf Rang 33. In einer anderen Harness-Konfiguration springt dasselbe Modell auf Rang 5. 28 Ränge Unterschied, identisches Modell. Das deutet auf Overfitting der Modelle auf spezifische Harness-Konfigurationen hin. Unternehmen, die sich auf eine einzige Umgebung verlassen, riskieren, bei Modellwechseln in die Leere zu laufen.

Warum Vercel, Manus und LangChain ihre Agenten umbauen: Vercel hat nach internem Test 80 Prozent der Tools aus seinem Agenten entfernt und dadurch Stabilität gewonnen. Manus hat sein System in sechs Monaten fünf Mal umgebaut. LangChain hat seinen Research-Agent dreimal in einem Jahr neu strukturiert. Die Botschaft: Der Harness ist kein einmaliges Investment. Er muss iterieren.

Die Praxis-Empfehlung von HumanLayer klingt fast banal, trifft aber den Kern: CLAUDE.md unter 60 Zeilen halten. Konfigurationen unter 60 Zeilen schlagen in der Praxis lange Guides. Jede zusätzliche Zeile kostet Tokens und lenkt das Modell ab. Der Einstieg in Harness Engineering ist nicht Komplexität, sondern Zurückhaltung. Erst bei echten Fehlern wird nachgelegt.

Deutsche und europäische Perspektive

Für den deutschen Mittelstand und europäische Enterprise-Kunden verschiebt Harness Engineering die Prioritäten. Wer bislang nur über Modellwahl, Hosting und DSGVO-Konformität nachdachte, muss jetzt auch die Laufzeit-Umgebung abbilden und dokumentieren. Das betrifft Einkauf, Architektur, Compliance und Governance gleichermaßen. Die Strategielücke im Mittelstand , in der 53 Prozent der Unternehmen an der Skalierung scheitern, ist auch eine Harness-Lücke.

Der EU AI Act verlangt Transparenz über Entscheidungen von KI-Systemen. Technisch bezieht sich diese Anforderung auf die komplette Kette aus Modell und Rahmenwerk, nicht nur auf das Modell. Wer nicht dokumentiert, welche Werkzeuge, Sub-Agenten und Hooks aktiv waren, kann eine Entscheidung nicht nachvollziehen. Der Harness wird damit vom technischen Detail zum Compliance-Artefakt. Die europäische Debatte um digitale Souveränität verschiebt sich entsprechend: Souveränität beginnt bei den Datenpfaden im Rahmenwerk, nicht bei der Wahl des Rechenzentrums.

Was deutsche Unternehmen anders machen müssen: Der Harness entscheidet, welche Daten wann wo landen. Europäische Kunden brauchen eine klare Antwort auf die Frage, ob Sub-Agenten Daten an Fremdsysteme senden oder in eigenen Sandboxes arbeiten. Wer mit Vendor Lock-in bei KI-Agenten-Plattformen kämpft, findet im Harness die Antwort auf die Austauschbarkeit. Offene Rahmenwerke wie das LangChain Agent SDK oder das HKUDS OpenHarness bieten Ausweichmöglichkeiten.

Der Energiebedarf ist die dritte europäische Dimension. Drei-Agenten-Setups kosten 20-mal so viel wie Single-Shot-Läufe, bringen aber auch deutlich bessere Ergebnisse. Für die Betreiber der deutschen Rechenzentrenstrategie bedeutet das eine zusätzliche Planungsgröße: Harness-Designs definieren die Lastkurven, nicht die Modelle. Ein Lauf mit mehreren parallelen Sub-Agenten erzeugt Lastspitzen, auf die Netz und Kühlung ausgelegt sein müssen.

Herausforderungen und Risiken

Harness Engineering ist kein Selbstläufer. Wer zu viel Infrastruktur baut, riskiert Komplexität und Vendor Lock-in. Wer zu wenig baut, scheitert an Context Rot und nicht reproduzierbaren Ergebnissen. Die Balance findet jedes Team nur durch eigene Messung.

Über-Engineering

HumanLayer warnt vor zu früh eingezogener Konfiguration. Die Empfehlung lautet: erst starten, dann bei echten Fehlern nachlegen. Jede zusätzliche Zeile in CLAUDE.md kostet Tokens und lenkt das Modell ab.

Abhängigkeit von einem Anbieter

Wer sein gesamtes Rahmenwerk auf Claude Code aufbaut, ist an eine Plattform gebunden. Die geleakten Architekturdetails zeigen zusätzlich, wie stark einzelne Entscheidungen das Verhalten prägen.

Context Rot

Mehr Kontext ist nicht gleich besser. Kontextfenster müssen aktiv verdichtet werden, sonst sinkt die Qualität. Chroma Research hat den Effekt messbar gemacht und er gilt für alle großen Modelle.

Beobachtbarkeit fehlt häufig

Ohne Logging der Tool-Aufrufe und Hooks sind Fehler schwer zu rekonstruieren. Ein Harness ohne Telemetrie ist wie ein Flugzeug ohne Flight Data Recorder.

Skill-Overfitting

Der Agent Skills Realitätscheck zeigt, dass die Nutzung von Skills im Idealfall funktioniert und in der Realität einbricht. Der Harness entscheidet, ob die Messung realistisch ist.

Kostenexplosion

Drei-Agenten-Setups kosten 20-mal so viel wie Single-Shot-Läufe. Ohne Budget-Guardrails eskalieren die Ausgaben schnell, vor allem bei langlaufenden Projekten ohne klare Abschlusskriterien.

Besonderes Risiko für den Mittelstand: Anthropics Experimente nutzen die stärksten verfügbaren Modelle. Viele deutsche Unternehmen setzen aus Kosten- oder Souveränitätsgründen auf kleinere oder offene Modelle. Ein Harness, der für Opus 4.6 optimiert wurde, funktioniert mit Kimi oder Qwen oft nicht gleichwertig. Die Harness-Konfiguration ist modellabhängig und muss für jede Modellwahl erneut getestet werden.

Was Unternehmen jetzt tun sollten

Konkrete Schritte, mit denen Entscheider das Thema strukturiert angehen können, statt auf das nächste Modell zu warten. Die sieben Punkte sind innerhalb von 90 Tagen umsetzbar und setzen keine Plattform-Entscheidung voraus. Sie orientieren sich an den Empfehlungen von Böckeler, HumanLayer, Schmid und Anthropic.

1. Inventar der aktuellen Tools und Hooks

Welche Werkzeuge, Hooks, Sub-Agenten und Kontextquellen sind heute im Einsatz? Undokumentierte Setups sind der häufigste Fehler. Eine einfache Tabelle mit Name, Zweck, Datenpfad und Owner reicht als Ausgangspunkt.

2. Klein anfangen und CLAUDE.md unter 60 Zeilen halten

Eine minimale Konfiguration mit wenigen Tools und kurzer CLAUDE.md ist dem Schweizer Taschenmesser vorzuziehen. Jede zusätzliche Regel muss einen nachweisbaren Fehler adressieren, nicht einen hypothetischen.

3. Feedback-Schleifen einbauen

Tests, Linter und Typechecks sind deterministische Sensoren, die ohne KI funktionieren und jede Aktion verifizieren. Sie sind billig, schnell und beweissicher. Jede Pipeline sollte mindestens eine deterministische Prüfung je Aktion haben.

4. Progress-Files für lange Projekte einführen

Langlaufende Projekte brauchen eine externe Fortschrittsdatei, damit neue Sessions den Stand schnell erfassen. Eine claude-progress.txt neben der Git-Historie ist der einfachste Einstieg. Die Datei enthält den aktuellen Stand, die nächsten Schritte und offene Fragen.

5. Metriken erfassen

Erfolgsrate pro Aufgabentyp, Kosten pro Task, Token-Verbrauch und Anzahl Kontext-Resets. Ohne diese vier Zahlen ist jede Harness-Debatte Meinungsaustausch, nicht Engineering.

6. Harness-Review alle 90 Tage

Alle drei Monate eine Architektur-Review mit Blick auf neue Modelle und Feedback aus echten Aufgaben. Der Harness ist kein einmaliges Investment, sondern ein lebender Bestandteil der Plattform. Manus, LangChain und Vercel haben mehrfach umgebaut, das sollte das Vorbild sein.

7. Mindestens zwei Umgebungen gegeneinander messen

Terminal Bench 2.0 zeigt, dass Modelle in unterschiedlichen Harness-Setups sehr unterschiedlich abschneiden. Claude Code gegen ein zweites Rahmenwerk zu benchmarken, deckt Overfitting und Abhängigkeiten schnell auf und schützt vor Überraschungen beim nächsten Modellwechsel.

Harness Engineering ist kein Innovationsprojekt, sondern Standard-Engineering-Disziplin für produktive KI-Agenten. Wer jetzt anfängt, baut Messung, Governance und Beobachtbarkeit in einem Aufwasch auf. Wer wartet, stellt in zwei Jahren fest, dass 40 Prozent der Projekte eingestellt werden, genau wie Gartner es vorhersagt.

Fazit

Harness Engineering ist die Disziplin, die 2026 darüber entscheidet, ob ein KI-Agent ein Produkt wird oder ein Experiment bleibt. Die Primärquellen sind eindeutig: Anthropic zeigt in zwei eigenen Studien, dass ein besseres Rahmenwerk die Erfolgsquote bei komplexen Aufgaben um den Faktor zwei bis drei steigert. Birgitta Böckeler liefert die klarste Taxonomie mit Guides und Sensors. Philipp Schmid schafft das Bild vom Harness als Betriebssystem. HumanLayer und die ETH Zürich warnen zu Recht vor Überautomatisierung.

Für deutsche Entscheider verschiebt sich die strategische Debatte. Die Frage ist nicht mehr, welches Modell gewählt wird, sondern welches Rahmenwerk in welcher Governance mit welcher Dokumentation. Der EU AI Act, die Rechenzentrenplanung, die Souveränitätsdebatte und die Bitkom-Mittelstandsstatistik treffen sich im Harness. Wer ihn beherrscht, hat einen konkreten technischen Hebel. Wer ihn ignoriert, redet 2027 über eingestellte Projekte.

Die gute Nachricht ist, dass der Einstieg klein bleibt. Eine kurze CLAUDE.md, eine Fortschrittsdatei, ein paar deterministische Tests und eine Inventarliste. Das sind die ersten 90 Tage. Danach folgen Messung, Iteration und Reviews. Harness Engineering ist keine Wissenschaft, die auf eine Durchbruchsentdeckung wartet. Es ist eine Ingenieursdisziplin, die sich durch Anwendung verbessert und durch Zurückhaltung nicht schadet.

Weiterführende Informationen

Häufig gestellte Fragen

Harness Engineering ist die Disziplin, alles rund um ein KI-Modell bewusst zu entwerfen: Werkzeuge, Kontext-Kuration, Feedback-Schleifen, Speicher, Sicherheits-Hooks und Sub-Agenten. Der Begriff hat sich 2026 durchgesetzt, nachdem Anthropic und OpenAI ihn in ihre Engineering-Kommunikation aufgenommen haben. Er beschreibt die Laufzeit-Umgebung um ein Sprachmodell, die Tool-Aufrufe koordiniert, Kontext kompaktiert, Sicherheit erzwingt und den Session-Zustand über Zeit hinweg hält.

Die Unterschiede zwischen den Spitzenmodellen auf statischen Benchmarks werden kleiner, die Unterschiede in der Laufzeit-Umgebung werden größer. Anthropics eigene Forschung zeigt, dass bessere Rahmenwerke die Erfolgsquote bei komplexen Aufgaben um den Faktor zwei bis drei steigern, ohne das Modell zu wechseln. Auf Terminal Bench 2.0 wandert Claude Opus 4.6 je nach Umgebung von Rang 33 auf Rang 5. Das zeigt, dass nicht das Modell, sondern die Umgebung über den Erfolg entscheidet.

Birgitta Böckeler von Thoughtworks definiert Harness Engineering am 2. April 2026 als Zusammenspiel aus Guides und Sensors. Guides greifen vor einer Aktion ein und verhindern Probleme, Sensors beobachten nach einer Aktion und ermöglichen Selbstkorrektur. Beide können deterministisch sein, etwa Linter und Typechecks, oder inferenziell, etwa eine semantische Prüfung durch ein weiteres KI-Modell. Die Unterscheidung hilft, Aufwand und Kosten bewusst zu verteilen.

Anthropic hat zwei Studien veröffentlicht. Am 26. November 2025 beschreibt Justin Young ein Zwei-Agenten-Rahmenwerk mit Initialisierer und Coder, das eine Feature-Liste mit über 200 Einträgen abarbeitet. Am 24. März 2026 stellt Prithvi Rajasekaran ein Drei-Agenten-Design aus Planner, Generator und Evaluator vor. Ein Retro-Game-Maker kam im Solo-Betrieb nach 20 Minuten und 9 US-Dollar zu keinem spielbaren Ergebnis. Mit vollem Rahmenwerk entstand nach sechs Stunden und rund 200 US-Dollar eine funktionsfähige App mit KI-Features.

Eine Studie der ETH Zürich zeigt, dass automatisch erzeugte Agent-Konfigurationsdateien die Performance verschlechtern und mehr als 20 Prozent zusätzliche Kosten verursachen, während handgeschriebene Dateien im Schnitt nur rund vier Prozent Verbesserung bringen. Chroma Research weist nach, dass die Antwortqualität mit zunehmender Kontextlänge sinkt, ein Effekt, der als Context Rot bekannt ist. Vercel hat 80 Prozent der Tools aus seinem Agenten entfernt und dadurch Stabilität gewonnen.

Erstens: Inventar der aktuellen Tool- und Hook-Landschaft. Zweitens: klein anfangen, CLAUDE.md unter 60 Zeilen halten. Drittens: Feedback-Schleifen mit Tests, Lintern und Typechecks einbauen. Viertens: Fortschrittsdateien für lange Projekte verwenden. Fünftens: kritische Metriken wie Erfolgsrate, Kosten pro Task und Context-Reset-Zahlen erfassen. Sechstens: das Rahmenwerk alle drei Monate überprüfen. Siebtens: Modelle in mindestens zwei Umgebungen gegeneinander messen, weil Terminal Bench 2.0 zeigt, dass dieselbe Konfiguration sehr unterschiedlich abschneidet.